Język programowania Rust

autorzy: Steve Klabnik, Carol Nichols i Chris Krycho, Maciej Ostrowski (przekład pl gemini-2.5-pro sty 26 r.), przy kontrybucjach Społeczności Rusta

Ta wersja tekstu zakłada, że używasz Rusta w wersji 1.90.0 (wydanie 2025-09-18)

lub nowszej z edition = "2024" w pliku Cargo.toml wszystkich projektów, aby

skonfigurować je do używania idiomów wydania Rust 2024. Zobacz sekcję „Instalacja”

w Rozdziale 1, aby uzyskać instrukcje dotyczące instalacji lub

aktualizacji Rusta, oraz Dodatek E, aby uzyskać informacje

o wydaniach.

Format HTML jest dostępny online pod adresem

https://doc.rust-lang.org/stable/book/

oraz offline z instalacjami Rusta wykonanymi za pomocą rustup; uruchom rustup doc --book, aby otworzyć.

Dostępne są również liczne [tłumaczenia] społeczności.

Ten tekst jest dostępny w formacie papierowym i ebooku od No Starch Press.

🚨 Chcesz bardziej interaktywnego doświadczenia edukacyjnego? Wypróbuj inną wersję Książki o Ruście, zawierającą: quizy, wyróżnienia, wizualizacje i wiele więcej: https://rust-book.cs.brown.edu

Przedmowa

Język programowania Rust przeszedł długą drogę w ciągu kilku krótkich lat, od jego stworzenia i inkubacji przez małą i rodzącą się społeczność entuzjastów, aż po stanie się jednym z najbardziej lubianych i poszukiwanych języków programowania na świecie. Z perspektywy czasu było nieuniknione, że moc i obietnica Rusta przyciągną uwagę i zakorzenią się w programowaniu systemowym. To, co nie było nieuniknione, to globalny wzrost zainteresowania i innowacji, który przeniknął przez społeczności open source i katalizował szeroko zakrojoną adopcję w różnych branżach.

W tym momencie łatwo jest wskazać wspaniałe cechy, które Rust ma do zaoferowania, aby wyjaśnić ten wybuch zainteresowania i adopcji. Kto nie chce bezpieczeństwa pamięci i szybkiej wydajności, i przyjaznego kompilatora, i wspaniałych narzędzi, pośród wielu innych wspaniałych funkcji? Język Rust, który widzisz dzisiaj, łączy lata badań w programowaniu systemowym z praktyczną mądrością tętniącej życiem i pełnej pasji społeczności. Ten język został zaprojektowany z myślą o celu i starannie wykonany, oferując deweloperom narzędzie, które ułatwia pisanie bezpiecznego, szybkiego i niezawodnego kodu.

Ale to, co czyni Rusta naprawdę wyjątkowym, to jego korzenie w umożliwianiu tobie, użytkownikowi, osiągania twoich celów. Jest to język, który chce, abyś odniósł sukces, a zasada wzmacniania pozycji przeplata się przez rdzeń społeczności, która buduje, utrzymuje i promuje ten język. Od poprzedniego wydania tego definitywnego tekstu, Rust rozwinął się w prawdziwie globalny i zaufany język. Projekt Rust jest teraz solidnie wspierany przez Fundację Rust, która również inwestuje w kluczowe inicjatywy, aby zapewnić, że Rust jest bezpieczny, stabilny i zrównoważony.

Niniejsze wydanie książki Język programowania Rust jest kompleksową aktualizacją, odzwierciedlającą ewolucję języka na przestrzeni lat i dostarczającą cennych nowych informacji. Ale to nie tylko przewodnik po składni i bibliotekach — to zaproszenie do przyłączenia się do społeczności, która ceni jakość, wydajność i przemyślany projekt. Niezależnie od tego, czy jesteś doświadczonym deweloperem, który po raz pierwszy chce poznać Rusta, czy doświadczonym Rustaceanem, który chce udoskonalić swoje umiejętności, to wydanie oferuje coś dla każdego.

Podróż z Rustem to podróż współpracy, nauki i iteracji. Rozwój języka i jego ekosystemu jest bezpośrednim odzwierciedleniem tętniącej życiem, różnorodnej społeczności, która za nim stoi. Kontrybucje tysięcy deweloperów, od projektantów podstawowych języków po okazjonalnych kontrybutorów, sprawiają, że Rust jest tak wyjątkowym i potężnym narzędziem. Biorąc tę książkę do ręki, nie tylko uczysz się nowego języka programowania — dołączasz do ruchu, który ma na celu ulepszanie oprogramowania, czynienie go bezpieczniejszym i przyjemniejszym w obsłudze.

Witaj w społeczności Rusta!

- Bec Rumbul, dyrektor wykonawcza Fundacji Rust

Wprowadzenie

Uwaga: To wydanie książki jest takie samo jak Język programowania Rust dostępny w formie drukowanej i ebooka od No Starch Press.

Witaj w Języku programowania Rust, książce wprowadzającej do Rusta. Język programowania Rust pomaga pisać szybsze, bardziej niezawodne oprogramowanie. Wysoka ergonomia i niska kontrola są często sprzeczne w projektowaniu języków programowania; Rust kwestionuje ten konflikt. Poprzez równoważenie potężnych możliwości technicznych i wspaniałego doświadczenia deweloperskiego, Rust daje możliwość kontrolowania niskopoziomowych szczegółów (takich jak użycie pamięci) bez wszystkich kłopotów tradycyjnie związanych z taką kontrolą.

Dla kogo jest Rust

Rust jest idealny dla wielu osób z różnych powodów. Przyjrzyjmy się kilku najważniejszym grupom.

Zespoły deweloperskie

Rust okazuje się być produktywnym narzędziem do współpracy między dużymi zespołami deweloperów o różnym poziomie znajomości programowania systemowego. Niskopoziomowy kod jest podatny na różne subtelne błędy, które w większości innych języków można wykryć jedynie poprzez obszerne testy i staranną weryfikację kodu przez doświadczonych deweloperów. W Ruście kompilator pełni rolę strażnika, odmawiając kompilacji kodu z tymi nieuchwytnymi błędami, w tym błędami współbieżności. Pracując obok kompilatora, zespół może poświęcić swój czas na skupienie się na logice programu, zamiast ścigać błędy.

Rust wprowadza również nowoczesne narzędzia dla deweloperów do świata programowania systemowego:

- Cargo, dołączony menedżer zależności i narzędzie do budowania, sprawia, że dodawanie, kompilowanie i zarządzanie zależnościami jest bezbolesne i spójne w całym ekosystemie Rusta.

- Narzędzie formatujące

rustfmtzapewnia spójny styl kodowania wśród deweloperów. - Rust Language Server zasila integrację ze zintegrowanymi środowiskami deweloperskimi (IDE) dla uzupełniania kodu i wbudowanych komunikatów o błędach.

Dzięki tym i innym narzędziom w ekosystemie Rusta, deweloperzy mogą być produktywni podczas pisania kodu na poziomie systemowym.

Studenci

Rust jest dla studentów i tych, którzy są zainteresowani nauką koncepcji systemowych. Używając Rusta, wiele osób uczyło się tematów takich jak rozwój systemów operacyjnych. Społeczność jest bardzo otwarta i chętnie odpowiada na pytania studentów. Poprzez wysiłki takie jak ta książka, zespoły Rusta chcą uczynić koncepcje systemowe bardziej dostępnymi dla większej liczby osób, szczególnie dla tych, którzy dopiero zaczynają programować.

Firmy

Setki firm, dużych i małych, używają Rusta w produkcji do różnych zadań, w tym narzędzi wiersza poleceń, usług sieciowych, narzędzi DevOps, urządzeń wbudowanych, analizy i transkodowania audio i wideo, kryptowalut, bioinformatyki, wyszukiwarek, aplikacji Internetu Rzeczy, uczenia maszynowego, a nawet głównych części przeglądarki internetowej Firefox.

Deweloperzy open source

Rust jest dla ludzi, którzy chcą budować język programowania Rust, społeczność, narzędzia deweloperskie i biblioteki. Chcielibyśmy, abyś wniósł swój wkład w rozwój języka Rust.

Ludzie ceniący szybkość i stabilność

Rust jest dla ludzi, którzy pragną szybkości i stabilności w języku. Przez szybkość rozumiemy zarówno to, jak szybko może działać kod Rusta, jak i szybkość, z jaką Rust pozwala pisać programy. Kontrole kompilatora Rusta zapewniają stabilność poprzez dodawanie funkcji i refaktoryzację. Jest to przeciwieństwo kruchego starego kodu w językach bez tych kontroli, którego deweloperzy często obawiają się modyfikować. Dążąc do abstrakcji zerokosztowych — funkcji wyższego poziomu, które kompilują się do kodu niższego poziomu tak szybko, jak kod napisany ręcznie — Rust stara się, aby bezpieczny kod był również szybkim kodem.

Język Rust ma nadzieję wspierać również wielu innych użytkowników; ci wspomniani tutaj to tylko niektórzy z największych interesariuszy. Ogólnie rzecz biorąc, największą ambicją Rusta jest wyeliminowanie kompromisów, które programiści akceptowali przez dziesięciolecia, zapewniając bezpieczeństwo i produktywność, szybkość i ergonomię. Spróbuj Rusta i zobacz, czy jego wybory sprawdzą się dla Ciebie.

Dla kogo jest ta książka

Ta książka zakłada, że pisałeś już kod w innym języku programowania, ale nie czyni żadnych założeń co do tego, w jakim. Staraliśmy się, aby materiał był szeroko dostępny dla osób z różnych środowisk programistycznych. Nie spędzamy wielu czasu na mówieniu o tym, czym jest programowanie ani jak o nim myśleć. Jeśli jesteś zupełnie początkujący w programowaniu, lepiej będzie, jeśli przeczytasz książkę, która specjalnie wprowadza w programowanie.

Jak korzystać z tej książki

Ogólnie rzecz biorąc, ta książka zakłada, że czytasz ją sekwencyjnie od początku do końca. Późniejsze rozdziały bazują na koncepcjach z wcześniejszych rozdziałów, a wcześniejsze rozdziały mogą nie zagłębiać się w szczegóły konkretnego tematu, ale powrócą do niego w późniejszym rozdziale.

W tej książce znajdziesz dwa rodzaje rozdziałów: rozdziały koncepcyjne i rozdziały projektowe. W rozdziałach koncepcyjnych dowiesz się o pewnym aspekcie Rusta. W rozdziałach projektowych będziemy wspólnie budować małe programy, stosując to, czego nauczyłeś się do tej pory. Rozdział 2, Rozdział 12 i Rozdział 21 to rozdziały projektowe; pozostałe to rozdziały koncepcyjne.

Rozdział 1 wyjaśnia, jak zainstalować Rusta, jak napisać program „Witaj, świecie!” i jak używać Cargo, menedżera pakietów i narzędzia do budowania Rusta. Rozdział 2 to praktyczne wprowadzenie do pisania programu w Ruście, polegające na budowaniu gry w zgadywanie liczb. Tutaj omawiamy koncepcje na wysokim poziomie, a późniejsze rozdziały dostarczą dodatkowych szczegółów. Jeśli chcesz od razu zabrać się do pracy, Rozdział 2 jest do tego idealnym miejscem. Jeśli jesteś szczególnie skrupulatnym uczniem, który woli poznać każdy szczegół przed przejściem do następnego, możesz pominąć Rozdział 2 i przejść bezpośrednio do Rozdziału 3, który obejmuje funkcje Rusta podobne do tych z innych języków programowania; następnie możesz wrócić do Rozdziału 2, kiedy będziesz chciał popracować nad projektem, stosując poznane szczegóły.

W Rozdziale 4 dowiesz się o systemie własności Rusta. Rozdział 5

omawia struktury i metody. Rozdział 6 obejmuje typy wyliczeniowe,

wyrażenia match oraz konstrukcje przepływu sterowania if let i let...else.

Użyjesz struktur i typów wyliczeniowych do tworzenia własnych typów.

W Rozdziale 7 dowiesz się o systemie modułów Rusta i zasadach prywatności dotyczących organizacji kodu i jego publicznego interfejsu programistycznego (API). Rozdział 8 omawia niektóre popularne struktury danych kolekcji dostępne w standardowej bibliotece: wektory, ciągi znaków i mapy haszujące. Rozdział 9 bada filozofię i techniki obsługi błędów Rusta.

Rozdział 10 zagłębia się w generyki, cechy i czasy życia, które dają ci

możliwość definiowania kodu, który stosuje się do wielu typów. Rozdział 11

polega na testowaniu, które nawet przy gwarancjach bezpieczeństwa Rusta jest

konieczne, aby upewnić się, że logika programu jest poprawna. W Rozdziale

12 zbudujemy naszą własną implementację podzbioru funkcjonalności narzędzia

wiersza poleceń grep, które wyszukuje tekst w plikach. W tym celu użyjemy

wielu koncepcji, które omówiliśmy w poprzednich rozdziałach.

Rozdział 13 bada domknięcia i iteratory: cechy Rusta pochodzące z funkcyjnych języków programowania. W Rozdziale 14 dokładniej zbadamy Cargo i porozmawiamy o najlepszych praktykach udostępniania bibliotek innym. Rozdział 15 omawia inteligentne wskaźniki dostępne w standardowej bibliotece oraz cechy, które umożliwiają ich funkcjonalność.

W Rozdziale 16 omówimy różne modele programowania współbieżnego i

porozmawiamy o tym, jak Rust pomaga programować w wielu wątkach bez obaw. W

Rozdziale 17 rozbudujemy to, badając składnię async i await Rusta, wraz

z zadaniami, futures i streams, oraz lekki model współbieżności, który

umożliwiają.

Rozdział 18 przygląda się, jak idiomy Rusta porównują się z zasadami programowania obiektowego, które możesz znać. Rozdział 19 to odniesienie do wzorców i dopasowywania wzorców, które są potężnymi sposobami wyrażania idei w programach Rusta. Rozdział 20 zawiera zbiór zaawansowanych tematów interesujących, w tym niebezpieczny Rust, makra i więcej o czasach życia, cechach, typach, funkcjach i domknięciach.

W Rozdziale 21 ukończymy projekt, w którym zaimplementujemy niskopoziomowy, wielowątkowy serwer WWW!

Na koniec, kilka dodatków zawiera użyteczne informacje o języku w formacie bardziej przypominającym referencje. Dodatek A obejmuje słowa kluczowe Rusta, Dodatek B obejmuje operatory i symbole Rusta, Dodatek C obejmuje cechy możliwe do wyprowadzenia dostarczane przez standardową bibliotekę, Dodatek D obejmuje niektóre użyteczne narzędzia programistyczne, a Dodatek E wyjaśnia wydania Rusta. W Dodatku F znajdziesz tłumaczenia książki, a w Dodatku G omówimy, jak powstaje Rust i czym jest Nightly Rust.

Nie ma złego sposobu na czytanie tej książki: Jeśli chcesz przeskoczyć do przodu, zrób to! Może będziesz musiał wrócić do wcześniejszych rozdziałów, jeśli spotkasz się z jakimkolwiek zamieszaniem. Ale rób to, co działa dla ciebie.

Ważną częścią procesu nauki Rusta jest nauka czytania komunikatów o błędach wyświetlanych przez kompilator: Będą one prowadzić Cię do działającego kodu. W związku z tym, przedstawimy wiele przykładów, które się nie kompilują, wraz z komunikatem o błędzie, który kompilator wyświetli w każdej sytuacji. Pamiętaj, że jeśli wpiszesz i uruchomisz przypadkowy przykład, może się on nie skompilować! Upewnij się, że przeczytałeś otaczający tekst, aby sprawdzić, czy przykład, który próbujesz uruchomić, ma celowo wyświetlić błąd. W większości sytuacji poprowadzimy Cię do poprawnej wersji kodu, który się nie kompiluje. Ferris również pomoże Ci rozróżnić kod, który nie ma działać:

| Ferris | Znaczenie |

|---|---|

| Ten kod się nie kompiluje! | |

| Ten kod panikuje! | |

| Ten kod nie daje pożądanego zachowania. |

W większości sytuacji poprowadzimy Cię do poprawnej wersji kodu, który się nie kompiluje.

Kod źródłowy

Pliki źródłowe, z których generowana jest ta książka, można znaleźć na GitHubie.

Pierwsze kroki

Rozpocznij swoją podróż z Rustem! Wiele jest do nauczenia, ale każda podróż zaczyna się gdzieś. W tym rozdziale omówimy:

- Instalację Rusta na Linuksie, macOS i Windows

- Pisanie programu, który wypisuje

Witaj, świecie! - Używanie

cargo, menedżera pakietów i systemu budowania Rusta

Instalacja

Instalacja

Pierwszym krokiem jest zainstalowanie Rusta. Pobierzemy Rusta za pośrednictwem

rustup, narzędzia wiersza poleceń do zarządzania wersjami Rusta i

powiązanymi narzędziami. Do pobrania będziesz potrzebować połączenia z

internetem.

Uwaga: Jeśli z jakiegoś powodu wolisz nie używać

rustup, zapoznaj się z stroną Inne metody instalacji Rusta w celu uzyskania dodatkowych opcji.

Poniższe kroki instalują najnowszą stabilną wersję kompilatora Rusta. Gwarancje stabilności Rusta zapewniają, że wszystkie przykłady w książce, które się kompilują, będą nadal kompilować się z nowszymi wersjami Rusta. Wynik może nieznacznie różnić się między wersjami, ponieważ Rust często poprawia komunikaty o błędach i ostrzeżenia. Innymi słowy, każda nowsza, stabilna wersja Rusta zainstalowana za pomocą tych kroków powinna działać zgodnie z oczekiwaniami z treścią tej książki.

Notacja wiersza poleceń

W tym rozdziale i w całej książce będziemy pokazywać niektóre polecenia używane w terminalu. Wiersze, które powinieneś wpisać w terminalu, zaczynają się od

$. Nie musisz wpisywać znaku$; jest to znak zachęty wiersza poleceń, który wskazuje początek każdego polecenia. Wiersze, które nie zaczynają się od$, zazwyczaj pokazują wynik poprzedniego polecenia. Dodatkowo, przykłady specyficzne dla PowerShell będą używać>zamiast$.

Instalacja rustup na Linuksie lub macOS

Jeśli używasz Linuksa lub macOS, otwórz terminal i wprowadź następujące polecenie:

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

Polecenie pobiera skrypt i rozpoczyna instalację narzędzia rustup, które

instaluje najnowszą stabilną wersję Rusta. Może zostać wyświetlony monit o

hasło. Jeśli instalacja zakończy się pomyślnie, pojawi się następujący wiersz:

Rust jest już zainstalowany. Świetnie!

Będziesz także potrzebował linkera, czyli programu, którego Rust używa do łączenia skompilowanych wyników w jeden plik. Prawdopodobnie już go masz. Jeśli otrzymasz błędy linkera, powinieneś zainstalować kompilator C, który zazwyczaj zawiera linker. Kompilator C jest również przydatny, ponieważ niektóre popularne pakiety Rusta zależą od kodu C i będą wymagały kompilatora C.

Na macOS możesz uzyskać kompilator C, uruchamiając:

$ xcode-select --install

Użytkownicy Linuksa powinni zazwyczaj instalować GCC lub Clang, zgodnie z

dokumentacją swojej dystrybucji. Na przykład, jeśli używasz Ubuntu, możesz

zainstalować pakiet build-essential.

Instalacja rustup na Windows

Na Windows, przejdź na https://www.rust-lang.org/tools/install i postępuj zgodnie z instrukcjami instalacji Rusta. W pewnym momencie instalacji zostaniesz poproszony o zainstalowanie Visual Studio. Zapewnia to linker i natywne biblioteki potrzebne do kompilowania programów. Jeśli potrzebujesz więcej pomocy w tym kroku, zobacz https://rust-lang.github.io/rustup/installation/windows-msvc.html.

Reszta tej książki używa poleceń, które działają zarówno w cmd.exe, jak i PowerShell. Jeśli wystąpią specyficzne różnice, wyjaśnimy, którego użyć.

Rozwiązywanie problemów

Aby sprawdzić, czy Rust jest poprawnie zainstalowany, otwórz powłokę i wrowadź ten wiersz:

$ rustc --version

Ppowinien pojawić się numer wersji, skrót commita i data commita dla najnowszej stabilnej wersji, która została wydana, w następującym formacie:

rustc x.y.z (abcabcabc yyyy-mm-dd)

Jeśli widzisz te informacje, pomyślnie zainstalowałeś Rusta! Jeśli ich nie

widzisz, sprawdź, czy Rust znajduje się w zmiennej systemowej %PATH% w

następujący sposób.

W systemie Windows CMD użyj:

> echo %PATH%

W PowerShellu użyj:

> echo $env:Path

Na Linuksie i macOS użyj:

$ echo $PATH

Jeśli wszystko jest w porządku, a Rust nadal nie działa, istnieje wiele miejsc, w których możesz uzyskać pomoc. Dowiedz się, jak skontaktować się z innymi Rustaceanami (tak się nazywamy) na stronie społeczności.

Aktualizacja i deinstalacja

Po zainstalowaniu Rusta za pomocą rustup, aktualizacja do nowo wydanej

wersji jest łatwa. Z poziomu powłoki uruchom następujący skrypt aktualizacji:

$ rustup update

Aby odinstalować Rusta i rustup, uruchom następujący skrypt odinstalowujący

z poziomu powłoki:

$ rustup self uninstall

Czytanie lokalnej dokumentacji

Instalacja Rusta zawiera również lokalną kopię dokumentacji, dzięki czemu

możesz czytać ją offline. Uruchom rustup doc, aby otworzyć lokalną

dokumentację w przeglądarce.

Zawsze, gdy typ lub funkcja jest dostarczana przez bibliotekę standardową, a nie masz pewności, co robi lub jak jej używać, skorzystaj z dokumentacji interfejsu programowania aplikacji (API), aby się dowiedzieć!

Używanie edytorów tekstu i środowisk IDE

Ta książka nie czyni żadnych założeń co do narzędzi, których używasz do pisania kodu Rusta. Niemal każdy edytor tekstu spełni swoje zadanie! Jednakże wiele edytorów tekstu i zintegrowanych środowisk programistycznych (IDE) posiada wbudowane wsparcie dla Rusta. Zawsze możesz znaleźć dość aktualną listę wielu edytorów i środowisk IDE na stronie z narzędziami na stronie internetowej Rusta.

Praca offline z tą książką

W kilku przykładach będziemy używać pakietów Rusta poza biblioteką standardową.

Aby przećwiczyć te przykłady, będziesz potrzebować połączenia z internetem

lub wcześniejszego pobrania tych zależności. Aby pobrać zależności wcześniej,

możesz uruchomić następujące polecenia. (Wyjaśnimy, czym jest cargo i co robi

każde z tych poleceń szczegółowo później.)

$ cargo new get-dependencies

$ cd get-dependencies

$ cargo add rand@0.8.5 trpl@0.2.0

Spowoduje to buforowanie pobrań tych pakietów, dzięki czemu nie będziesz

musiał ich później pobierać. Po uruchomieniu tego polecenia nie musisz

zatrzymywać folderu get-dependencies. Jeśli uruchomiłeś to polecenie,

możesz użyć flagi --offline ze wszystkimi poleceniami cargo w pozostałej

części książki, aby użyć tych buforowanych wersji zamiast próbować używać

sieci.

Witaj, świecie!

Witaj, świecie!

Skoro zainstalowałeś Rusta, czas napisać swój pierwszy program w tym języku.

Tradycyjnie, ucząc się nowego języka, pisze się mały program, który wyświetla

tekst Witaj, świecie! na ekranie, więc zrobimy to samo i tutaj!

Uwaga: Ta książka zakłada podstawową znajomość wiersza poleceń. Rust nie stawia żadnych specyficznych wymagań dotyczących edycji, narzędzi ani miejsca przechowywania kodu, więc jeśli wolisz używać IDE zamiast wiersza poleceń, śmiało korzystaj ze swojego ulubionego IDE. Wiele środowisk IDE ma obecnie pewne wsparcie dla Rusta; sprawdź dokumentację IDE, aby uzyskać szczegółowe informacje. Zespół Rusta skupia się na zapewnieniu doskonałego wsparcia IDE za pośrednictwem

rust-analyzer. Więcej szczegółów znajdziesz w Dodatku D.

Konfiguracja katalogu projektu

Zaczniesz od utworzenia katalogu do przechowywania kodu Rusta. Dla Rusta nie ma znaczenia, gdzie znajduje się Twój kod, ale dla ćwiczeń i projektów w tej książce sugerujemy utworzenie katalogu projects w katalogu domowym i przechowywanie tam wszystkich swoich projektów.

Otwórz terminal i wprowadź następujące polecenia, aby utworzyć katalog projects i katalog dla projektu „Witaj, świecie!” w katalogu projects.

Na Linuksie, macOS i w PowerShell na Windows, wprowadź:

$ mkdir ~/projects

$ cd ~/projects

$ mkdir hello_world

$ cd hello_world

W systemie Windows CMD wprowadź:

> mkdir "%USERPROFILE%\projects"

> cd /d "%USERPROFILE%\projects"

> mkdir hello_world

> cd hello_world

Podstawy programu w Ruście

Następnie utwórz nowy plik źródłowy i nazwij go main.rs. Pliki Rusta zawsze kończą się rozszerzeniem .rs. Jeśli używasz więcej niż jednego słowa w nazwie pliku, konwencją jest używanie podkreślenia do ich rozdzielania. Na przykład użyj hello_world.rs zamiast helloworld.rs.

Teraz otwórz nowo utworzony plik main.rs i wprowadź kod z Listingu 1-1.

fn main() {

println!("Hello, world!");

}Zapisz plik i wróć do okna terminala w katalogu ~/projects/hello_world. Na Linuksie lub macOS wprowadź następujące polecenia, aby skompilować i uruchomić plik:

$ rustc main.rs

$ ./main

Hello, world!

Na Windows wprowadź polecenie .\main zamiast ./main:

> rustc main.rs

> .\main

Hello, world!

Niezależnie od systemu operacyjnego, w terminalu powinno pojawić się

Witaj, świecie!. Jeśli nie widzisz tego wyjścia, wróć do części „Rozwiązywanie

problemów” w sekcji Instalacja, aby uzyskać pomoc.

Jeśli Witaj, świecie! zostało wypisane, gratulacje! Oficjalnie napisałeś

program w Ruście. To czyni Cię programistą Rusta – witaj!

Anatomia programu w Ruście

Przejrzyjmy szczegółowo ten program „Witaj, świecie!”. Oto pierwszy element układanki:

fn main() {

}Te wiersze definiują funkcję o nazwie main. Funkcja main jest specjalna:

Zawsze jest pierwszym kodem, który jest uruchamiany w każdym wykonywalnym

programie w Ruście. Tutaj pierwszy wiersz deklaruje funkcję o nazwie main,

która nie ma parametrów i nic nie zwraca. Gdyby były parametry, znalazłyby się

w nawiasach ().

Ciało funkcji jest ujęte w {}. Rust wymaga nawiasów klamrowych wokół

wszystkich ciał funkcji. Dobrym stylem jest umieszczanie otwierającego nawiasu

klamrowego w tym samym wierszu co deklaracja funkcji, dodając jeden odstęp

pomiędzy nimi.

Uwaga: Jeśli chcesz trzymać się standardowego stylu w projektach Rusta, możesz użyć automatycznego narzędzia formatującego o nazwie

rustfmtdo formatowania kodu w określonym stylu (więcej orustfmtw Dodatku D). Zespół Rusta dołączył to narzędzie do standardowej dystrybucji Rusta, podobnie jakrustc, więc powinno być już zainstalowane na Twoim komputerze!

Ciało funkcji main zawiera następujący kod:

#![allow(unused)]

fn main() {

println!("Hello, world!");

}Ten wiersz wykonuje całą pracę w tym małym programie: wyświetla tekst na ekranie. Należy zwrócić uwagę na trzy ważne szczegóły.

Po pierwsze, println! wywołuje makro Rusta. Gdyby wywoływało funkcję, byłoby

wpisane jako println (bez !). Makra Rusta to sposób na pisanie kodu, który

generuje kod w celu rozszerzenia składni Rusta, a omówimy je bardziej

szczegółowo w Rozdziale 20. Na razie wystarczy

wiedzieć, że użycie ! oznacza wywołanie makra zamiast normalnej funkcji, a

makra nie zawsze przestrzegają tych samych zasad co funkcje.

Po drugie, widzisz ciąg znaków "Hello, world!". Przekazujemy ten ciąg jako

argument do println!, a ciąg jest wyświetlany na ekranie.

Po trzecie, kończymy wiersz średnikiem (;), co oznacza, że to wyrażenie

zostało zakończone, a następne jest gotowe do rozpoczęcia. Większość wierszy

kodu Rusta kończy się średnikiem.

Kompilacja i wykonanie

Właśnie uruchomiłeś nowo utworzony program, więc przyjrzyjmy się każdemu krokowi w tym procesie.

Przed uruchomieniem programu w Ruście musisz go skompilować za pomocą

kompilatora Rusta, wpisując polecenie rustc i podając nazwę pliku źródłowego,

w ten sposób:

$ rustc main.rs

Jeśli masz doświadczenie z C lub C++, zauważysz, że jest to podobne do gcc

lub clang. Po pomyślnej kompilacji Rust wypisuje plik wykonywalny.

Na Linuksie, macOS i w PowerShell na Windows, możesz zobaczyć plik wykonywalny,

wpisując polecenie ls w swojej powłoce:

$ ls

main main.rs

Na Linuksie i macOS zobaczysz dwa pliki. W PowerShell na Windows zobaczysz te same trzy pliki, które zobaczyłbyś używając CMD. W CMD na Windows wypisałbyś następujące polecenie:

> dir /B %= opcja /B wyświetla tylko nazwy plików =%

main.exe

main.pdb

main.rs

Pokazuje to plik kodu źródłowego z rozszerzeniem .rs, plik wykonywalny (main.exe na Windows, ale main na wszystkich innych platformach) oraz, w przypadku używania Windows, plik zawierający informacje debugowania z rozszerzeniem .pdb. Stąd uruchamiasz plik main lub main.exe, w ten sposób:

$ ./main # lub .\main na Windows

Jeśli twój main.rs to program „Witaj, świecie!”, ten wiersz wypisze Witaj, świecie! w twoim terminalu.

Jeśli jesteś bardziej zaznajomiony z językami dynamicznymi, takimi jak Ruby, Python lub JavaScript, możesz nie być przyzwyczajony do kompilowania i uruchamiania programu jako oddzielnych kroków. Rust jest językiem kompilowanym z wyprzedzeniem, co oznacza, że możesz skompilować program i przekazać plik wykonywalny komuś innemu, a ta osoba może go uruchomić nawet bez zainstalowanego Rusta. Jeśli przekażesz komuś plik .rb, .py lub .js, ta osoba musi mieć zainstalowaną (odpowiednio) implementację Ruby, Pythona lub JavaScriptu. Ale w tych językach potrzebujesz tylko jednego polecenia, aby skompilować i uruchomić program. Wszystko jest kompromisem w projektowaniu języka.

Samo kompilowanie za pomocą rustc jest wystarczające dla prostych programów,

ale w miarę rozrostu projektu będziesz chciał zarządzać wszystkimi opcjami i

ułatwić udostępnianie kodu. Następnie przedstawimy narzędzie Cargo, które pomoże

Ci pisać rzeczywiste programy w Ruście.

Witaj, Cargo!

Witaj, Cargo!

Cargo to system budowania i menedżer pakietów Rusta. Większość Rustaceanów używa tego narzędzia do zarządzania swoimi projektami w Ruście, ponieważ Cargo obsługuje wiele zadań za Ciebie, takich jak budowanie kodu, pobieranie bibliotek, od których zależy Twój kod, i budowanie tych bibliotek. (Biblioteki, których potrzebuje Twój kod, nazywamy zależnościami.)

Najprostsze programy w Ruście, takie jak ten, który do tej pory napisaliśmy, nie mają żadnych zależności. Gdybyśmy zbudowali projekt „Witaj, świecie!” za pomocą Cargo, używałby on tylko części Cargo, która obsługuje budowanie kodu. W miarę pisania bardziej złożonych programów w Ruście, będziesz dodawać zależności, a jeśli rozpoczniesz projekt za pomocą Cargo, dodawanie zależności będzie znacznie łatwiejsze.

Ponieważ zdecydowana większość projektów w Ruście używa Cargo, reszta tej książki zakłada, że Ty również używasz Cargo. Cargo jest instalowane wraz z Rustem, jeśli użyłeś oficjalnych instalatorów omówionych w sekcji „Instalacja”. Jeśli zainstalowałeś Rusta innymi sposobami, sprawdź, czy Cargo jest zainstalowane, wpisując w terminalu:

$ cargo --version

Jeśli widzisz numer wersji, masz go! Jeśli widzisz błąd, taki jak command not found, poszukaj w dokumentacji swojej metody instalacji, aby ustalić, jak

zainstalować Cargo oddzielnie.

Tworzenie projektu za pomocą Cargo

Utwórzmy nowy projekt za pomocą Cargo i przyjrzyjmy się, jak różni się od naszego oryginalnego projektu „Witaj, świecie!”. Wróć do katalogu projects (lub gdziekolwiek zdecydowałeś się przechowywać swój kod). Następnie, na każdym systemie operacyjnym, uruchom:

$ cargo new hello_cargo

$ cd hello_cargo

Pierwsze polecenie tworzy nowy katalog i projekt o nazwie hello_cargo. Nazwaliśmy nasz projekt hello_cargo, a Cargo tworzy swoje pliki w katalogu o tej samej nazwie.

Przejdź do katalogu hello_cargo i wypisz pliki. Zobaczysz, że Cargo wygenerowało dla nas dwa pliki i jeden katalog: plik Cargo.toml i katalog src z plikiem main.rs w środku.

Zainicjowało również nowe repozytorium Git wraz z plikiem .gitignore.

Pliki Git nie zostaną wygenerowane, jeśli uruchomisz cargo new w istniejącym

repozytorium Git; możesz nadpisać to zachowanie, używając cargo new --vcs=git.

Uwaga: Git to popularny system kontroli wersji. Możesz zmienić

cargo new, aby używać innego systemu kontroli wersji lub żadnego, używając flagi--vcs. Uruchomcargo new --help, aby zobaczyć dostępne opcje.

Otwórz Cargo.toml w swoim ulubionym edytorze tekstu. Powinien wyglądać podobnie do kodu z Listingu 1-2.

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2024"

[dependencies]

Ten plik jest w formacie TOML (Tom’s Obvious, Minimal Language), który jest formatem konfiguracyjnym Cargo.

Pierwszy wiersz, [package], to nagłówek sekcji wskazujący, że następne

instrukcje konfigurują pakiet. W miarę dodawania kolejnych informacji do tego

pliku, będziemy dodawać inne sekcje.

Trzy następne wiersze ustawiają informacje konfiguracyjne, których Cargo

potrzebuje do skompilowania programu: nazwę, wersję i wydanie Rusta do

użycia. Omówimy klucz edition w Dodatku E.

Ostatni wiersz, [dependencies], to początek sekcji, w której możesz wymienić

wszystkie zależności swojego projektu. W Ruście pakiety kodu są nazywane

skrzynkami. Nie będziemy potrzebować żadnych innych skrzynek do tego projektu,

ale będziemy potrzebować ich w pierwszym projekcie w Rozdziale 2, więc

skorzystamy z tej sekcji zależności wtedy.

Teraz otwórz src/main.rs i przyjrzyj się:

Nazwa pliku: src/main.rs

fn main() {

println!("Hello, world!");

}Cargo wygenerowało dla Ciebie program „Witaj, świecie!”, dokładnie taki jak ten, który napisaliśmy w Listingu 1-1! Do tej pory różnice między naszym projektem a projektem wygenerowanym przez Cargo polegały na tym, że Cargo umieściło kod w katalogu src, a my mamy plik konfiguracyjny Cargo.toml w najwyższym katalogu.

Cargo oczekuje, że Twoje pliki źródłowe będą znajdować się w katalogu src. Katalog projektu najwyższego poziomu jest przeznaczony tylko na pliki README, informacje licencyjne, pliki konfiguracyjne i wszystko inne, co nie jest związane z Twoim kodem. Korzystanie z Cargo pomaga w organizacji projektów. Wszystko ma swoje miejsce i wszystko jest na swoim miejscu.

Jeśli rozpocząłeś projekt, który nie używa Cargo, tak jak to zrobiliśmy z

projektem „Witaj, świecie!”, możesz przekonwertować go na projekt, który używa

Cargo. Przenieś kod projektu do katalogu src i utwórz odpowiedni plik

Cargo.toml. Łatwym sposobem na uzyskanie pliku Cargo.toml jest uruchomienie

cargo init, które utworzy go dla Ciebie automatycznie.

Budowanie i uruchamianie projektu Cargo

Teraz przyjrzyjmy się, co się zmieni, gdy zbudujemy i uruchomimy program „Witaj, świecie!” za pomocą Cargo! Z katalogu hello_cargo zbuduj swój projekt, wypisując następujące polecenie:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 2.85 secs

To polecenie tworzy plik wykonywalny w target/debug/hello_cargo (lub target\debug\hello_cargo.exe na Windows), a nie w bieżącym katalogu. Ponieważ domyślna kompilacja jest kompilacją debugową, Cargo umieszcza plik binarny w katalogu o nazwie debug. Możesz uruchomić plik wykonywalny za pomocą tego polecenia:

$ ./target/debug/hello_cargo # lub .\target\debug\hello_cargo.exe na Windows

Hello, world!

Jeśli wszystko pójdzie dobrze, w terminalu powinno zostać wyświetlone

Witaj, świecie!. Uruchomienie cargo build po raz pierwszy powoduje również,

że Cargo tworzy nowy plik na najwyższym poziomie: Cargo.lock. Ten plik śledzi

dokładne wersje zależności w Twoim projekcie. Ten projekt nie ma zależności,

więc plik jest nieco skąpy. Nigdy nie będziesz musiał ręcznie zmieniać tego

pliku; Cargo zarządza jego zawartością za Ciebie.

Właśnie zbudowaliśmy projekt za pomocą cargo build i uruchomiliśmy go za

pomocą ./target/debug/hello_cargo, ale możemy również użyć cargo run,

aby skompilować kod, a następnie uruchomić wynikowy plik wykonywalny za

jednym poleceniem:

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Używanie cargo run jest wygodniejsze niż konieczność pamiętania o

uruchamianiu cargo build, a następnie używaniu pełnej ścieżki do pliku

binearnego, więc większość deweloperów używa cargo run.

Zauważ, że tym razem nie widzieliśmy wyjścia wskazującego, że Cargo kompiluje

hello_cargo. Cargo ustaliło, że pliki nie uległy zmianie, więc nie

przebudowywało, a jedynie uruchomiło plik binarny. Gdybyś zmodyfikował swój kod

źródłowy, Cargo przebudowałoby projekt przed jego uruchomieniem, a Ty

zobaczyłbyś takie wyjście:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

Cargo udostępnia również polecenie cargo check. To polecenie szybko

sprawdza Twój kod, aby upewnić się, że kompiluje się, ale nie tworzy pliku

wykonywalnego:

$ cargo check

Checking hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.32 secs

Dlaczego nie chciałbyś pliku wykonywalnego? Często cargo check jest

zauważalnie szybsze niż cargo build, ponieważ pomija krok tworzenia pliku

wykonywalnego. Jeśli stale sprawdzasz swoją pracę podczas pisania kodu,

użycie cargo check przyspieszy proces informowania Cię, czy Twój projekt

nadal się kompiluje! W związku z tym wielu Rustaceanów uruchamia cargo check

periodycznie podczas pisania programu, aby upewnić się, że się kompiluje.

Następnie uruchamiają cargo build, gdy są gotowi do użycia pliku

wykonywalnego.

Podsumujmy, czego do tej pory nauczyliśmy się o Cargo:

- Możemy utworzyć projekt za pomocą

cargo new. - Możemy zbudować projekt za pomocą

cargo build. - Możemy zbudować i uruchomić projekt w jednym kroku za pomocą

cargo run. - Możemy zbudować projekt bez tworzenia pliku binarnego, aby sprawdzić błędy,

za pomocą

cargo check. - Zamiast zapisywać wynik kompilacji w tym samym katalogu co nasz kod, Cargo przechowuje go w katalogu target/debug.

Dodatkową zaletą używania Cargo jest to, że polecenia są takie same, niezależnie od systemu operacyjnego, na którym pracujesz. Tak więc, w tym momencie nie będziemy już podawać konkretnych instrukcji dla Linuksa i macOS w stosunku do Windows.

Budowanie do wersji produkcyjnej

Kiedy Twój projekt jest wreszcie gotowy do wydania, możesz użyć cargo build --release, aby skompilować go z optymalizacjami. To polecenie utworzy plik

wykonywalny w target/release zamiast target/debug. Optymalizacje sprawiają,

że kod Rusta działa szybciej, ale ich włączenie wydłuża czas kompilacji

programu. Dlatego istnieją dwa różne profile: jeden do rozwoju, gdy chcesz

szybko i często przebudowywać, a drugi do budowania ostatecznego programu,

który przekażesz użytkownikowi, który nie będzie wielokrotnie przebudowywany i

który będzie działał tak szybko, jak to możliwe. Jeśli mierzysz czas

uruchamiania kodu, upewnij się, że uruchamiasz cargo build --release i

mierzysz wydajność z plikiem wykonywalnym w target/release.

Wykorzystanie konwencji Cargo

W przypadku prostych projektów Cargo nie zapewnia dużej wartości w porównaniu

z samym używaniem rustc, ale udowodni swoją wartość, gdy Twoje programy

staną się bardziej złożone. Gdy programy rozrosną się do wielu plików lub

będą wymagały zależności, znacznie łatwiej jest pozwolić Cargo

koordynować budowanie.

Mimo że projekt hello_cargo jest prosty, wykorzystuje teraz wiele

rzeczywistych narzędzi, których będziesz używać w pozostałej części swojej

kariery z Rustem. W rzeczywistości, aby pracować nad istniejącymi projektami,

możesz użyć następujących poleceń, aby pobrać kod za pomocą Git, przejść do

katalogu tego projektu i zbudować:

$ git clone example.org/someproject

$ cd someproject

$ cargo build

Więcej informacji na temat Cargo znajdziesz w jego dokumentacji.

Podsumowanie

Już świetnie zacząłeś swoją podróż z Rustem! W tym rozdziale nauczyłeś się:

- Jak zainstalować najnowszą stabilną wersję Rusta za pomocą

rustup. - Jak zaktualizować Rusta do nowszej wersji.

- Jak otworzyć lokalnie zainstalowaną dokumentację.

- Jak napisać i uruchomić program „Witaj, świecie!” bezpośrednio za pomocą

rustc. - Jak utworzyć i uruchomić nowy projekt, korzystając z konwencji Cargo.

To świetny moment, aby zbudować bardziej rozbudowany program, aby przyzwyczaić się do czytania i pisania kodu w Ruście. Tak więc, w Rozdziale 2 zbudujemy program do zgadywania liczb. Jeśli wolisz zacząć od nauki, jak działają powszechne koncepcje programistyczne w Ruście, zobacz Rozdział 3, a następnie wróć do Rozdziału 2.

Programowanie gry w zgadywanie

Zanurzmy się w Rust, realizując wspólnie praktyczny projekt! Ten rozdział

wprowadza cię w kilka popularnych koncepcji Rusta, pokazując, jak używać ich

w prawdziwym programie. Dowiesz się o let, match, metodach, funkcjach

skojarzonych, zewnętrznych “crate’ach” i wielu innych! W kolejnych

rozdziałach będziemy badać te idee bardziej szczegółowo. W tym rozdziale

będziesz ćwiczyć tylko podstawy.

Zaimplementujemy klasyczny problem programistyczny dla początkujących: grę w zgadywanie. Działa to tak: program wygeneruje losową liczbę całkowitą od 1 do 100. Następnie poprosi gracza o podanie strzału. Po wprowadzeniu strzału, program wskaże, czy strzał jest za niski, czy za wysoki. Jeśli strzał jest prawidłowy, gra wyświetli komunikat gratulacyjny i zakończy się.

Konfiguracja nowego projektu

Aby skonfigurować nowy projekt, przejdź do katalogu projects, który utworzyłeś w Rozdziale 1, i utwórz nowy projekt za pomocą Cargo, w następujący sposób:

$ cargo new guessing_game

$ cd guessing_game

Pierwsze polecenie, cargo new, przyjmuje nazwę projektu (guessing_game) jako

pierwszy argument. Drugie polecenie zmienia katalog na katalog nowego projektu.

Spójrz na wygenerowany plik Cargo.toml:

Nazwa pliku: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2024"

[dependencies]

Jak widziałeś w Rozdziale 1, cargo new generuje program “Hello, world!” dla

Ciebie. Sprawdź plik src/main.rs:

Nazwa pliku: src/main.rs

fn main() {

println!("Hello, world!");

}Teraz skompilujmy ten program “Hello, world!” i uruchommy go w tym samym kroku,

używając polecenia cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.08s

Running `target/debug/guessing_game`

Hello, world!

Polecenie run przydaje się, gdy trzeba szybko iterować nad projektem, tak

jak będziemy to robić w tej grze, szybko testując każdą iterację, zanim

przejdziemy do następnej.

Otwórz ponownie plik src/main.rs. Cały kod będziesz pisać w tym pliku.

Przetwarzanie strzału

Pierwsza część programu do zgadywania liczb poprosi o dane wejściowe od użytkownika, przetworzy je i sprawdzi, czy dane są w oczekiwanej formie. Na początek pozwolimy graczowi wprowadzić strzał. Wprowadź kod z Listingu 2-1 do src/main.rs.

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Ten kod zawiera wiele informacji, więc przeanalizujmy go linia po linii. Aby

pobrać dane od użytkownika, a następnie wyświetlić wynik, musimy wprowadzić

bibliotekę wejścia/wyjścia io do zakresu. Biblioteka io pochodzi ze

standardowej biblioteki, znanej jako std:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Domyślnie Rust ma zestaw elementów zdefiniowanych w standardowej bibliotece, które są wprowadzane do zakresu każdego programu. Ten zestaw nazywa się preludium, a wszystko w nim możesz zobaczyć w dokumentacji biblioteki standardowej.

Jeśli typ, którego chcesz użyć, nie znajduje się w preludium, musisz

explicitnie wprowadzić ten typ do zakresu za pomocą instrukcji use. Użycie

biblioteki std::io zapewnia wiele przydatnych funkcji, w tym możliwość

przyjmowania danych wejściowych od użytkownika.

Jak widziałeś w Rozdziale 1, funkcja main jest punktem wejścia do programu:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Składnia fn deklaruje nową funkcję; nawiasy () wskazują, że nie ma

parametrów; a nawias klamrowy { rozpoczyna ciało funkcji.

Jak również dowiedziałeś się w Rozdziale 1, println! to makro, które

wyświetla ciąg znaków na ekranie:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Ten kod wyświetla komunikat informujący, czym jest gra, i prosi użytkownika o wprowadzenie danych.

Przechowywanie wartości w zmiennych

Następnie utworzymy zmienną do przechowywania danych wprowadzonych przez użytkownika, w ten sposób:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Teraz program staje się ciekawszy! W tej krótkiej linii dzieje się dużo. Używamy

instrukcji let do utworzenia zmiennej. Oto inny przykład:

let apples = 5;Ta linia tworzy nową zmienną o nazwie apples i wiąże ją z wartością 5.

W Rust zmienne są domyślnie niezmienne, co oznacza, że gdy raz nadamy

zmiennej wartość, wartość ta nie ulegnie zmianie. Omówimy tę koncepcję

szczegółowo w sekcji „Zmienne i mutowalność”

nazwą zmiennej:

let apples = 5; // niezmienna

let mut bananas = 5; // mutowalnaUwaga: Składnia // rozpoczyna komentarz, który trwa do końca linii. Rust

ignoruje wszystko, co znajduje się w komentarzach. Omówimy komentarze

szczegółowo w Rozdziale 3.

Wracając do programu gry w zgadywanie, wiesz już, że let mut guess wprowadzi

mutowalną zmienną o nazwie guess. Znak równości (=) mówi Rustowi, że

chcemy teraz powiązać coś ze zmienną. Po prawej stronie znaku równości

znajduje się wartość, z którą guess jest powiązane, czyli wynik wywołania

String::new, funkcji, która zwraca nową instancję typu String.

String to typ ciągu znaków dostarczony przez

standardową bibliotekę, który jest rozszerzalnym, kodowanym UTF-8 fragmentem

tekstu.

Składnia :: w linii ::new wskazuje, że new jest funkcją skojarzoną z

typem String. Funkcja skojarzona to funkcja zaimplementowana dla danego

typu, w tym przypadku String. Ta funkcja new tworzy nowy, pusty ciąg

znaków. Funkcję new znajdziesz na wielu typach, ponieważ jest to

powszechna nazwa dla funkcji, która tworzy nową wartość jakiegoś rodzaju.

Podsumowując, linia let mut guess = String::new(); utworzyła mutowalną

zmienną, która jest obecnie powiązana z nową, pustą instancją String. Uff!

Odbieranie danych od użytkownika

Przypomnijmy, że na początku programu dołączyliśmy funkcjonalność wejścia/

wyjścia ze standardowej biblioteki za pomocą use std::io;. Teraz wywołamy

funkcję stdin z modułu io, co pozwoli nam obsługiwać dane wejściowe od

użytkownika:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Gdybyśmy nie zaimportowali modułu io za pomocą use std::io; na początku

programu, nadal moglibyśmy użyć funkcji, pisząc wywołanie funkcji jako

std::io::stdin. Funkcja stdin zwraca instancję

std::io::Stdin, która jest typem

reprezentującym uchwyt do standardowego wejścia dla Twojego terminala.

Następnie, linia .read_line(&mut guess) wywołuje metodę

read_line na uchwycie standardowego wejścia

w celu pobrania danych od użytkownika. Przekazujemy również &mut guess jako

argument do read_line, aby powiedzieć jej, w którym ciągu znaków ma

przechowywać dane wejściowe od użytkownika. Pełnym zadaniem read_line jest

pobranie wszystkiego, co użytkownik wpisze do standardowego wejścia, i

dodanie tego do ciągu znaków (bez nadpisywania jego zawartości), dlatego

przekazujemy ten ciąg znaków jako argument. Argument ciągu znaków musi być

mutowalny, aby metoda mogła zmieniać zawartość ciągu znaków.

Znak & wskazuje, że ten argument jest referencją, co pozwala wielu

częściom Twojego kodu uzyskać dostęp do jednego fragmentu danych bez

konieczności wielokrotnego kopiowania tych danych do pamięci. Referencje są

złożoną funkcją, a jedną z głównych zalet Rusta jest to, jak bezpieczne i

łatwe jest używanie referencji. Nie musisz znać wielu z tych szczegółów, aby

zakończyć ten program. Na razie wystarczy wiedzieć, że podobnie jak zmienne,

referencje są domyślnie niezmienne. Dlatego musisz napisać &mut guess zamiast

&guess, aby uczynić ją mutowalną. (Rozdział 4 wyjaśni referencje bardziej

dokładnie).

Obsługa potencjalnych błędów za pomocą Result

Nadal pracujemy nad tą linią kodu. Teraz omawiamy trzecią linię tekstu, ale zwróć uwagę, że jest to nadal część jednej logicznej linii kodu. Następna część to ta metoda:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Ten kod mogliśmy napisać jako:

io::stdin().read_line(&mut guess).expect("Failed to read line");Jednak jedna długa linia jest trudna do odczytania, więc najlepiej jest ją

podzielić. Często rozsądne jest wprowadzenie nowej linii i innych białych

znaków, aby ułatwić czytanie długich linii, gdy wywołujesz metodę za pomocą

składni .method_name(). Teraz omówmy, co ta linia robi.

Jak wspomniano wcześniej, read_line umieszcza wszystko, co użytkownik

wprowadzi, w przekazanym jej ciągu znaków, ale zwraca również wartość Result.

Result to wyliczenie enums,

często nazywane enum, które jest typem mogącym przyjmować jeden z wielu

możliwych stanów. Każdy możliwy stan nazywamy wariantem.

Rozdział 6 omówi szczegółowo enums. Celem tych

typów Result jest kodowanie informacji o obsłudze błędów.

Wariantami Result są Ok i Err. Wariant Ok wskazuje, że operacja

zakończyła się sukcesem i zawiera pomyślnie wygenerowaną wartość. Wariant Err

oznacza, że operacja zakończyła się niepowodzeniem i zawiera informacje o tym,

jak lub dlaczego operacja się nie powiodła.

Wartości typu Result, podobnie jak wartości każdego typu, mają zdefiniowane

na nich metody. Instancja Result ma metodę expect,

którą możesz wywołać. Jeśli ta instancja Result jest wartością Err,

expect spowoduje awarię programu i wyświetli komunikat, który przekazałeś

jako argument do expect. Jeśli metoda read_line zwróci Err, będzie to

prawdopodobnie wynikiem błędu pochodzącego z bazowego systemu operacyjnego.

Jeśli ta instancja Result jest wartością Ok, expect pobierze wartość

zwracaną, którą przechowuje Ok, i zwróci ci tylko tę wartość, abyś mógł jej

użyć. W tym przypadku ta wartość to liczba bajtów w danych wejściowych

użytkownika.

Jeśli nie wywołasz expect, program skompiluje się, ale otrzymasz ostrzeżenie:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

help: use `let _ = ...` to ignore the resulting value

|

10 | let _ = io::stdin().read_line(&mut guess);

| +++++++

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.59s

Rust ostrzega, że nie użyłeś wartości Result zwróconej z read_line,

wskazując, że program nie obsłużył możliwego błędu.

Właściwym sposobem na stłumienie ostrzeżenia jest faktyczne napisanie kodu

do obsługi błędów, ale w naszym przypadku chcemy po prostu, aby ten program

uległ awarii, gdy wystąpi problem, więc możemy użyć expect. Dowiesz się o

recoverowaniu z błędów w Rozdziale 9.

Wyświetlanie wartości za pomocą znaczników println!

Poza końcowym nawiasem klamrowym, pozostała tylko jedna linia do omówienia w dotychczasowym kodzie:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Ta linia wyświetla ciąg znaków, który teraz zawiera dane wejściowe

użytkownika. Zestaw nawiasów klamrowych {} to znacznik miejsca:

Wyobraź sobie {} jako małe szczypce kraba, które trzymają wartość na miejscu.

Podczas wyświetlania wartości zmiennej nazwa zmiennej może znajdować się w

środku nawiasów klamrowych. Podczas wyświetlania wyniku oceny wyrażenia,

umieść puste nawiasy klamrowe w ciągu formatującym, a następnie po ciągu

formatującym umieść listę wyrażeń oddzielonych przecinkami, które mają być

wyświetlone w każdym pustym znaczniku miejsca w tej samej kolejności.

Wyświetlanie zmiennej i wyniku wyrażenia w jednym wywołaniu println!

wyglądałoby tak:

#![allow(unused)]

fn main() {

let x = 5;

let y = 10;

println!("x = {x} and y + 2 = {}", y + 2);

}Ten kod wydrukowałby x = 5 and y + 2 = 12.

Testowanie pierwszej części

Przetestujmy pierwszą część gry w zgadywanie. Uruchom ją za pomocą cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 6.44s

Running `target/debug/guessing_game`

Guess the number!

Please input your guess.

6

You guessed: 6

W tym momencie pierwsza część gry jest gotowa: pobieramy dane z klawiatury, a następnie je wyświetlamy.

Generowanie tajnej liczby

Następnie musimy wygenerować tajną liczbę, którą użytkownik będzie próbował

zgadnąć. Tajna liczba powinna być inna za każdym razem, aby gra była zabawna

do wielokrotnego grania. Użyjemy losowej liczby od 1 do 100, aby gra nie była

zbyt trudna. Rust nie zawiera jeszcze funkcji do generowania liczb losowych w

standardowej bibliotece. Jednak zespół Rusta udostępnia pakiet rand

crate z tą funkcjonalnością.

Zwiększanie funkcjonalności za pomocą pakietu

Pamiętaj, że crate to zbiór plików źródłowych Rusta. Projekt, który budujemy,

jest binary crate, czyli plikiem wykonywalnym. Crate rand to library

crate, który zawiera kod przeznaczony do użycia w innych programach i nie może

być wykonywany samodzielnie.

Koordynacja zewnętrznych crate'ów przez Cargo to miejsce, w którym Cargo

naprawdę błyszczy. Zanim będziemy mogli napisać kod, który używa rand,

musimy zmodyfikować plik Cargo.toml, aby dodać rand jako zależność.

Otwórz ten plik teraz i dodaj następującą linię na dole, pod nagłówkiem

sekcji [dependencies], który Cargo dla Ciebie utworzył. Upewnij się, że

określasz rand dokładnie tak, jak tutaj, z tym numerem wersji, w przeciwnym

razie przykłady kodu w tym samouczku mogą nie działać:

Nazwa pliku: Cargo.toml

[dependencies]

rand = "0.8.5"

W pliku Cargo.toml wszystko, co następuje po nagłówku, jest częścią tej

sekcji, która trwa, dopóki nie rozpocznie się inna sekcja. W [dependencies]

informujesz Cargo, od których zewnętrznych pakietów zależy Twój projekt i

których wersji tych pakietów potrzebujesz. W tym przypadku określamy pakiet

rand ze specyfikatorem wersji semantycznej 0.8.5. Cargo rozumie Semantic

Versioning (czasami nazywane SemVer), który jest

standardem zapisu numerów wersji. Specyfikator 0.8.5 jest w rzeczywistości

skrótem od ^0.8.5, co oznacza dowolną wersję co najmniej 0.8.5, ale

padającą poniżej 0.9.0.

Cargo uważa, że te wersje mają publiczne API kompatybilne z wersją 0.8.5, a ta specyfikacja gwarantuje, że otrzymasz najnowszą wersję poprawki, która nadal będzie kompilować się z kodem w tym rozdziale. Żadna wersja 0.9.0 lub większa nie gwarantuje tego samego API, co w poniższych przykładach.

Teraz, bez zmiany kodu, zbudujmy projekt, jak pokazano w Listingu 2-2.

$ cargo build

Updating crates.io index

Locking 15 packages to latest Rust 1.85.0 compatible versions

Adding rand v0.8.5 (available: v0.9.0)

Compiling proc-macro2 v1.0.93

Compiling unicode-ident v1.0.17

Compiling libc v0.2.170

Compiling cfg-if v1.0.0

Compiling byteorder v1.5.0

Compiling getrandom v0.2.15

Compiling rand_core v0.6.4

Compiling quote v1.0.38

Compiling syn v2.0.98

Compiling zerocopy-derive v0.7.35

Compiling zerocopy v0.7.35

Compiling ppv-lite86 v0.2.20

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.48s

cargo build po dodaniu rand jako zależnościMożesz zobaczyć różne numery wersji (ale wszystkie będą kompatybilne z kodem, dzięki SemVer!) i różne linie (w zależności od systemu operacyjnego), a linie mogą być w innej kolejności.

Gdy dołączamy zewnętrzną zależność, Cargo pobiera najnowsze wersje wszystkiego, czego ta zależność potrzebuje, z rejestru, który jest kopią danych z Crates.io. Crates.io to miejsce, w którym ludzie w ekosystemie Rusta publikują swoje projekty Rust open source, aby inni mogli z nich korzystać.

Po zaktualizowaniu rejestru Cargo sprawdza sekcję [dependencies] i pobiera

wszystkie wymienione pakiety, które nie zostały jeszcze pobrane. W tym

przypadku, choć wymieniliśmy tylko rand jako zależność, Cargo pobrał również

inne pakiety, od których zależy rand, aby działał. Po pobraniu pakietów

Rust kompiluje je, a następnie kompiluje projekt z dostępnymi zależnościami.

Jeśli natychmiast ponownie uruchomisz cargo build bez wprowadzania żadnych

zmian, nie otrzymasz żadnych danych wyjściowych poza linią Finished.

Cargo wie, że już pobrał i skompilował zależności, a Ty nie zmieniłeś nic

w pliku Cargo.toml. Cargo wie również, że nie zmieniłeś nic w swoim kodzie,

więc nie kompiluje go ponownie. Nie mając nic do zrobienia, po prostu

kończy działanie.

Jeśli otworzysz plik src/main.rs, dokonasz trywialnej zmiany, a następnie zapiszesz go i ponownie zbudujesz, zobaczysz tylko dwie linie danych wyjściowych:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.13s

Te linie pokazują, że Cargo aktualizuje kompilację tylko o Twoją drobną zmianę w pliku src/main.rs. Twoje zależności nie uległy zmianie, więc Cargo wie, że może ponownie wykorzystać to, co już pobrał i skompilował dla nich.

Zapewnianie powtarzalnych kompilacji za pomocą pliku Cargo.lock

Cargo posiada mechanizm, który zapewnia, że możesz odbudować ten sam artefakt

za każdym razem, gdy Ty lub ktokolwiek inny buduje Twój kod: Cargo będzie używać

tylko tych wersji zależności, które określiłeś, chyba że wskażesz inaczej. Na

przykład, powiedzmy, że w przyszłym tygodniu zostanie wydana wersja 0.8.6 pakietu

rand, a ta wersja zawiera ważną poprawkę błędu, ale zawiera również regresję,

która zepsuje Twój kod. Aby temu zaradzić, Rust tworzy plik Cargo.lock za

pierwszym razem, gdy uruchamiasz cargo build, więc teraz mamy go w katalogu

guessing_game.

Kiedy budujesz projekt po raz pierwszy, Cargo ustala wszystkie wersje zależności, które spełniają kryteria, a następnie zapisuje je do pliku Cargo.lock. Kiedy budujesz swój projekt w przyszłości, Cargo zobaczy, że plik Cargo.lock istnieje i użyje tam określonych wersji, zamiast ponownie wykonywać całej pracy związanej z ustalaniem wersji. Pozwala to na automatyczne powtarzalne budowanie. Innymi słowy, Twój projekt pozostanie w wersji 0.8.5, dopóki wyraźnie go nie zaktualizujesz, dzięki plikowi Cargo.lock. Ponieważ plik Cargo.lock jest ważny dla powtarzalnych kompilacji, często jest dodawany do kontroli wersji wraz z resztą kodu w Twoim projekcie.

Aktualizacja “crate’a”, aby uzyskać nową wersję

Kiedy chcesz zaktualizować pakiet, Cargo udostępnia polecenie update, które

zignoruje plik Cargo.lock i ustali wszystkie najnowsze wersje, które pasują

do twoich specyfikacji w Cargo.toml. Cargo następnie zapisze te wersje do

pliku Cargo.lock. W przeciwnym razie, domyślnie, Cargo będzie szukać tylko

wersji większych niż 0.8.5 i mniejszych niż 0.9.0. Jeśli pakiet rand wydał

dwie nowe wersje 0.8.6 i 0.999.0, zobaczyłbyś następujące, gdybyś uruchomił

cargo update:

$ cargo update

Updating crates.io index

Locking 1 package to latest Rust 1.85.0 compatible version

Updating rand v0.8.5 -> v0.8.6 (available: v0.999.0)

Cargo ignoruje wydanie 0.999.0. W tym momencie zauważyłbyś również zmianę w

pliku Cargo.lock, wskazującą, że wersja pakietu rand, której teraz używasz,

to 0.8.6. Aby użyć wersji rand 0.999.0 lub dowolnej wersji z serii 0.999.x,

musiałbyś zamiast tego zaktualizować plik Cargo.toml, aby wyglądał tak (nie

wprowadzaj tej zmiany, ponieważ poniższe przykłady zakładają, że używasz rand

0.8):

[dependencies]

rand = "0.999.0"

Następnym razem, gdy uruchomisz cargo build, Cargo zaktualizuje rejestr

dostępnych pakietów i ponownie oceni Twoje wymagania dotyczące rand zgodnie z

nową wersją, którą określiłeś.

Wiele jest do powiedzenia na temat Cargo i jego ekosystemu, które omówimy w Rozdziale 14, ale na razie to wszystko, co musisz wiedzieć. Cargo bardzo ułatwia ponowne używanie bibliotek, więc Rustowcy mogą pisać mniejsze projekty, które są montowane z wielu pakietów.

Generowanie liczby losowej

Zacznijmy używać rand do generowania liczby do zgadnięcia. Następnym krokiem

jest aktualizacja src/main.rs, jak pokazano w Listingu 2-3.

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Najpierw dodajemy linię use rand::Rng;. Cecha Rng definiuje metody,

które implementują generatory liczb losowych, i ta cecha musi być w zakresie,

abyśmy mogli używać tych metod. Rozdział 10 szczegółowo omówi cechy.

Następnie dodajemy dwie linie w środku. W pierwszej linii wywołujemy funkcję

rand::thread_rng, która daje nam konkretny generator liczb losowych, którego

będziemy używać: taki, który jest lokalny dla bieżącego wątku wykonawczego

i jest inicjowany przez system operacyjny. Następnie wywołujemy metodę

gen_range na generatorze liczb losowych. Ta metoda jest zdefiniowana przez

cechę Rng, którą wprowadziliśmy do zakresu za pomocą instrukcji

use rand::Rng;. Metoda gen_range przyjmuje wyrażenie zakresu jako argument

i generuje liczbę losową w tym zakresie. Rodzaj wyrażenia zakresu, którego tu

używamy, ma postać start..=end i jest inkluzywny na dolnej i górnej granicy,

więc musimy określić 1..=100, aby zażądać liczby od 1 do 100.

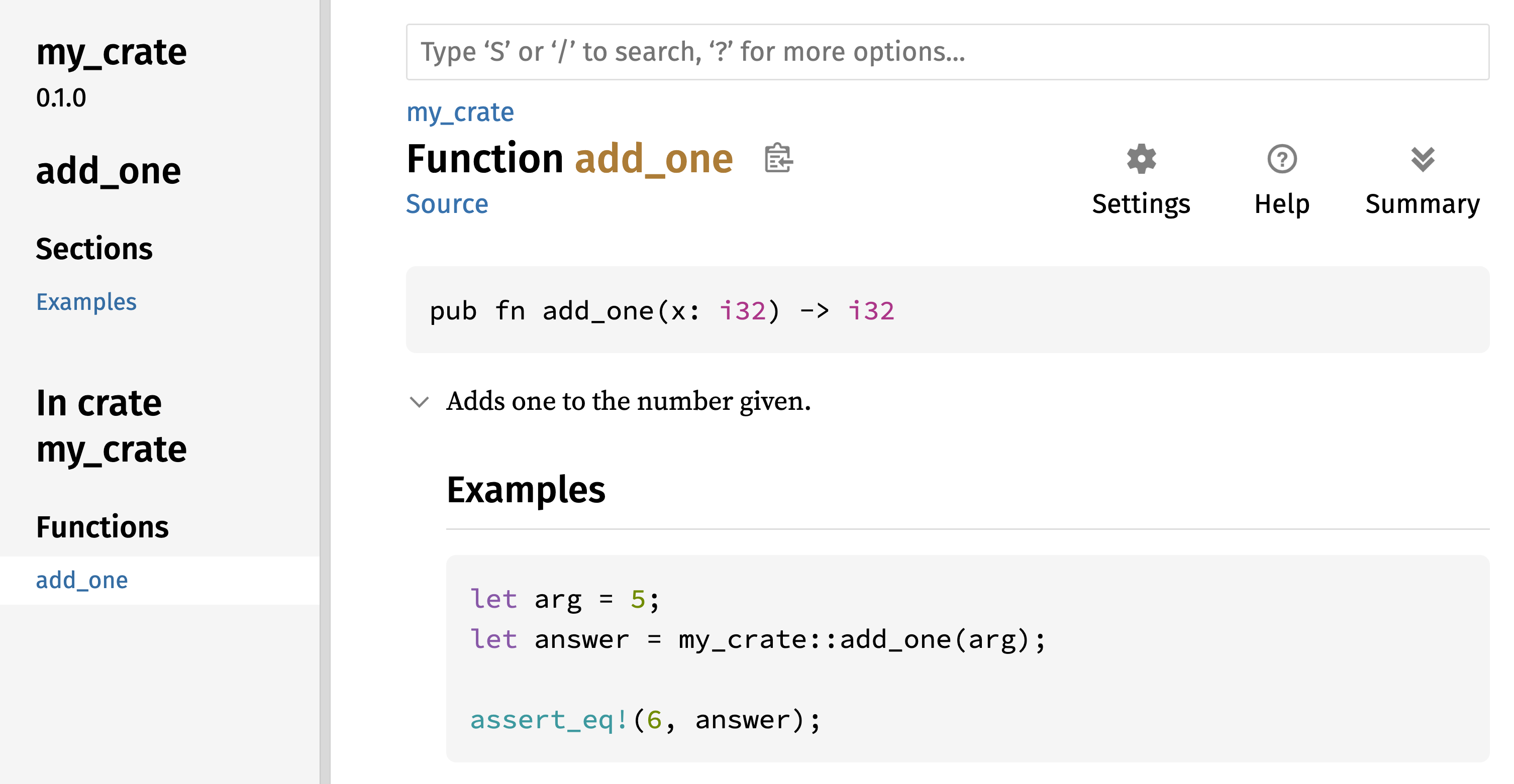

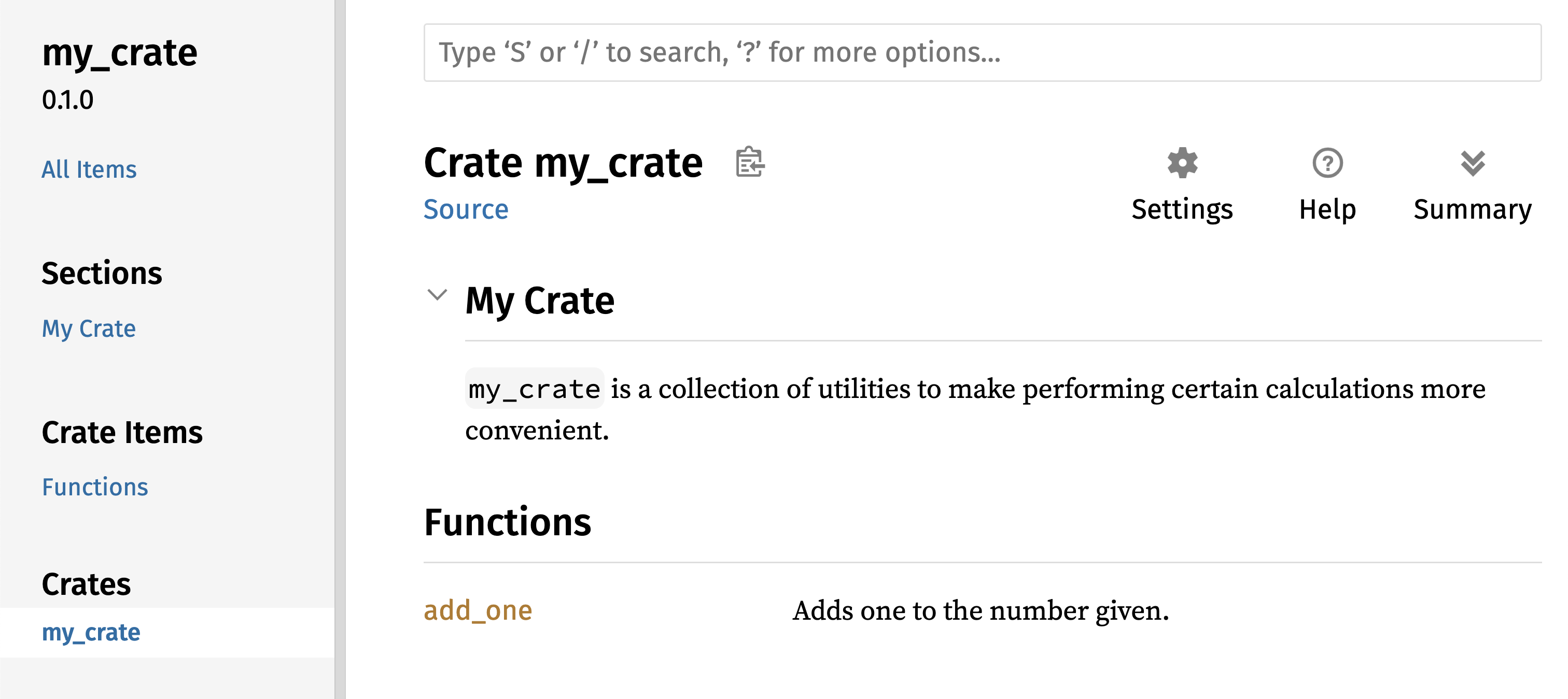

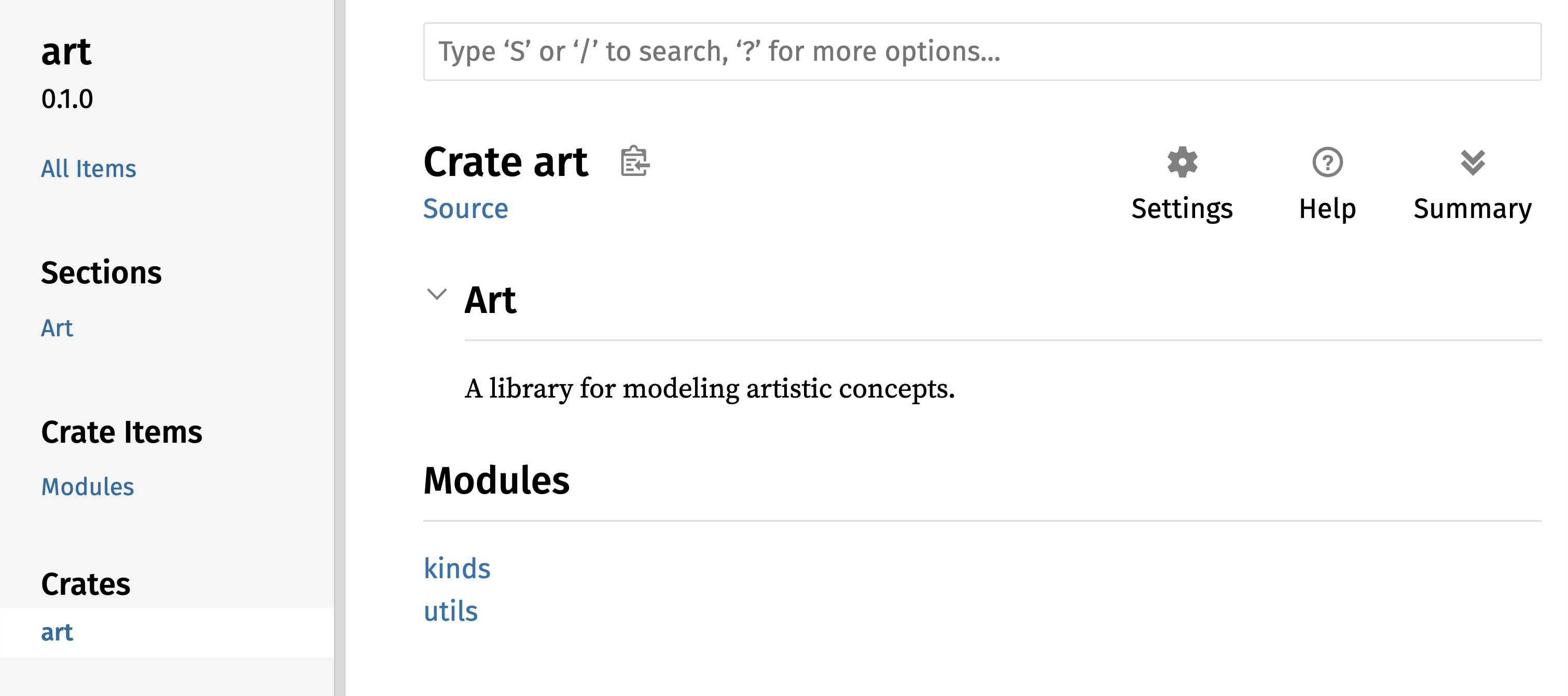

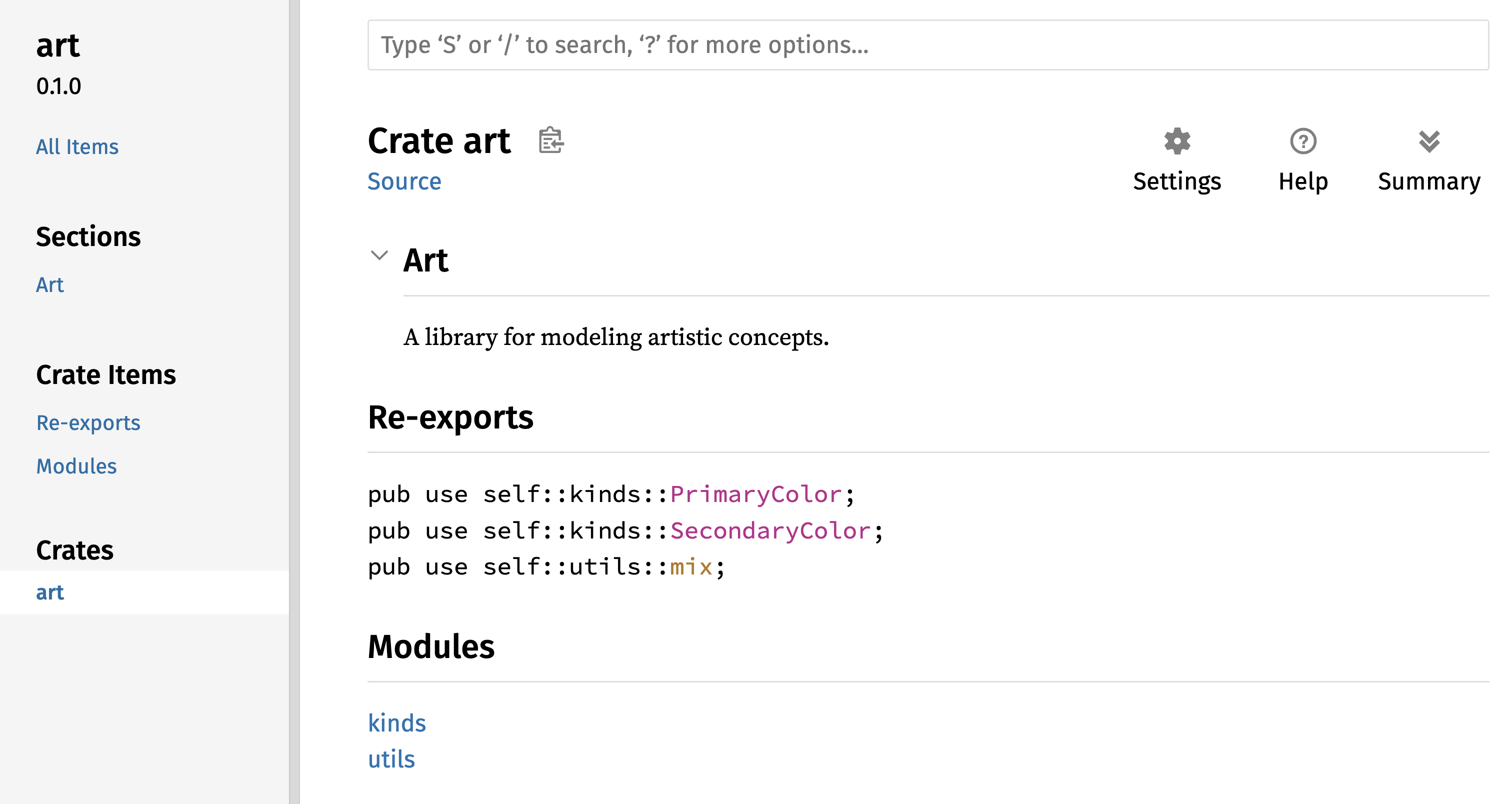

Uwaga: Nie będziesz po prostu wiedział, których cech używać i które metody

i funkcje wywoływać z “crate’a”, więc każdy “crate” ma dokumentację z

instrukcjami jego używania. Inną fajną funkcją Cargo jest to, że uruchomienie

polecenia cargo doc --open zbuduje dokumentację dostarczoną przez wszystkie

Twoje zależności lokalnie i otworzy ją w Twojej przeglądarce. Jeśli interesuje

Cię inna funkcjonalność w “crate’cie” rand, na przykład, uruchom

cargo doc --open i kliknij rand na pasku bocznym po lewej stronie.

Druga nowa linia wyświetla tajną liczbę. Jest to przydatne podczas opracowywania programu, aby móc go przetestować, ale usuniemy ją z ostatecznej wersji. Nie ma sensu grać, jeśli program wyświetla odpowiedź zaraz po uruchomieniu!

Spróbuj uruchomić program kilka razy:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 7

Please input your guess.

4

You guessed: 4

$ cargo run

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 83

Please input your guess.

5

You guessed: 5

Powinieneś otrzymać różne liczby losowe, i wszystkie powinny być liczbami pomiędzy 1 a 100. Świetna robota!

Porównywanie strzału z tajną liczbą

Teraz, gdy mamy dane wejściowe od użytkownika i liczbę losową, możemy je porównać. Ten krok jest pokazany w Listingu 2-4. Zauważ, że ten kod na razie się nie skompiluje, co wyjaśnimy.

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

// --snip--

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}Najpierw dodajemy kolejną instrukcję use, wprowadzając typ o nazwie

std::cmp::Ordering do zakresu ze standardowej biblioteki. Typ Ordering to

kolejne wyliczenie (enum) i ma warianty Less, Greater i Equal. Są to

trzy możliwe wyniki porównania dwóch wartości.

Następnie dodajemy pięć nowych linii na dole, które używają typu Ordering.

Metoda cmp porównuje dwie wartości i może być wywołana na wszystkim, co

można porównać. Przyjmuje referencję do tego, z czym chcesz porównać: tutaj

porównuje guess z secret_number. Następnie zwraca wariant wyliczenia

Ordering, które wprowadziliśmy do zakresu za pomocą instrukcji use.

Używamy wyrażenia match, aby zdecydować, co zrobić

dalej, w oparciu o to, który wariant Ordering został zwrócony z wywołania

cmp z wartościami w guess i secret_number.

Wyrażenie match składa się z ramion. Ramię składa się z wzorca, z którym

ma być dopasowywana wartość, oraz kodu, który powinien zostać uruchomiony, jeśli

wartość podana do match pasuje do wzorca tego ramienia. Rust pobiera wartość

podaną do match i kolejno przegląda wzorce każdego ramienia. Patrzy na

wzorzec pierwszego ramienia, Ordering::Less, i widzi, że wartość

Ordering::Greater nie pasuje do Ordering::Less, więc ignoruje kod w tym

ramieniu i przechodzi do następnego ramienia. Wzorzec następnego ramienia to

Ordering::Greater, który pasuje do Ordering::Greater! Powiązany kod w

tym ramieniu zostanie wykonany i wyświetli na ekranie Too big!. Wyrażenie

match kończy się po pierwszym udanym dopasowaniu, więc w tym scenariuszu

nie będzie patrzeć na ostatnie ramię.

Jednak kod w Listingu 2-4 jeszcze się nie skompiluje. Spróbujmy:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:23:21

|

23 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected `&String`, found `&{integer}`

| |

| arguments to this method are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: method defined here

--> /rustc/1159e78c4747b02ef996e55082b704c09b970588/library/core/src/cmp.rs:979:8

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` (bin "guessing_game") due to 1 previous error

Rdzeń błędu stwierdza, że występują niezgodne typy. Rust ma silny, statyczny

system typów. Jednak ma również inferencję typów. Kiedy napisaliśmy

let mut guess = String::new(), Rust był w stanie wywnioskować, że guess

powinno być String i nie kazał nam pisać tego typu. secret_number natomiast

jest typem liczbowym. Kilka typów liczbowych Rusta może mieć wartość pomiędzy

1 a 100: i32, liczba 32-bitowa; u32, niepodpisana liczba 32-bitowa; i64,

liczba 64-bitowa; oraz inne. O ile nie określono inaczej, Rust domyślnie używa

i32, który jest typem secret_number, chyba że dodasz informacje o typie w

innym miejscu, co spowodowałoby, że Rust wywnioskowałby inny typ liczbowy.

Powodem błędu jest to, że Rust nie może porównywać ciągu znaków i typu

liczbowego.

Ostatecznie chcemy przekonwertować String, którą program odczytuje jako dane

wejściowe, na typ liczbowy, abyśmy mogli porównać ją numerycznie z tajną

liczbą. Robimy to, dodając tę linię do ciała funkcji main:

Nazwa pliku: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}Linia to:

let guess: u32 = guess.trim().parse().expect("Please type a number!");Tworzymy zmienną o nazwie guess. Ale chwila, czy program nie ma już zmiennej

o nazwie guess? Tak, ale Rust pozwala nam w korzystny sposób zacienić

poprzednią wartość guess nową. Zacienianie pozwala nam ponownie użyć nazwy

zmiennej guess, zamiast zmuszać nas do tworzenia dwóch unikalnych zmiennych,

takich jak guess_str i guess, na przykład. Omówimy to szczegółowo w

Rozdziale 3, ale na razie wiedz, że ta funkcja jest

często używana, gdy chcesz przekonwertować wartość z jednego typu na inny.

Wiązamy tę nową zmienną z wyrażeniem guess.trim().parse(). guess w

wyrażeniu odnosi się do oryginalnej zmiennej guess, która zawierała dane

wejściowe jako ciąg znaków. Metoda trim na instancji String usunie

wszelkie białe znaki na początku i na końcu, co musimy zrobić, zanim

przekonwertujemy ciąg znaków na u32, który może zawierać tylko dane

liczbowe. Użytkownik musi nacisnąć enter, aby zadowolić read_line i

wprowadzić swój strzał, co dodaje znak nowej linii do ciągu znaków. Na

przykład, jeśli użytkownik wpisze 5 i naciśnie enter, guess

będzie wyglądało tak: 5\n. \n oznacza “nową linię”. (W systemie Windows

naciśnięcie enter powoduje powrót karetki i nową linię, \r\n.) Metoda

trim usuwa \n lub \r\n, pozostawiając tylko 5.

Metoda parse na ciągach znaków konwertuje ciąg

znaków na inny typ. Tutaj używamy jej do konwersji z ciągu znaków na liczbę.

Musimy powiedzieć Rustowi dokładny typ liczbowy, którego chcemy, używając

let guess: u32. Dwukropek (:) po guess mówi Rustowi, że będziemy

anotować typ zmiennej. Rust ma kilka wbudowanych typów liczbowych; u32

widziane tutaj to niepodpisana, 32-bitowa liczba całkowita. Jest to dobry

domyślny wybór dla małej liczby dodatniej. O innych typach liczbowych dowiesz

się w Rozdziale 3.

Dodatkowo, adnotacja u32 w tym przykładzie programu i porównanie z

secret_number oznacza, że Rust wywnioskuje, iż secret_number również

powinno być u32. Tak więc, teraz porównanie będzie dotyczyło dwóch wartości

tego samego typu!

Metoda parse będzie działać tylko na znakach, które można logicznie

przekształcić na liczby i dlatego może łatwo powodować błędy. Gdyby, na

przykład, ciąg znaków zawierał A👍%, nie byłoby sposobu na przekształcenie

tego na liczbę. Ponieważ może to zakończyć się niepowodzeniem, metoda parse

zwraca typ Result, podobnie jak metoda read_line (omówiona wcześniej w

sekcji „Obsługa potencjalnych błędów za pomocą Result”).

Będziemy traktować ten Result w ten sam sposób, ponownie używając metody

expect. Jeśli parse zwróci wariant Err Result, ponieważ nie udało się

utworzyć liczby z ciągu znaków, wywołanie expect spowoduje awarię gry i

wyświetli komunikat, który mu podamy. Jeśli parse z powodzeniem przekonwertuje

ciąg znaków na liczbę, zwróci wariant Ok Result, a expect zwróci liczbę,

której chcemy z wartości Ok.

Uruchommy teraz program:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.26s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 58

Please input your guess.

76

You guessed: 76

Too big!

Świetnie! Mimo że przed zgadywaną liczbą dodano spacje, program nadal rozpoznał, że użytkownik zgadł 76. Uruchom program kilka razy, aby sprawdzić różne zachowania z różnymi rodzajami danych wejściowych: zgadnij liczbę poprawnie, zgadnij liczbę, która jest za wysoka, i zgadnij liczbę, która jest za niska.

Mamy już większość gry działającą, ale użytkownik może wykonać tylko jeden strzał. Zmieńmy to, dodając pętlę!

Zezwalanie na wielokrotne zgadywanie za pomocą pętli

Słowo kluczowe loop tworzy nieskończoną pętlę. Dodamy pętlę, aby dać

użytkownikom więcej szans na odgadnięcie liczby:

Nazwa pliku: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

// --snip--

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}

}Jak widać, przenieśliśmy wszystko od monitu o wprowadzenie zgadywanej liczby dalej do pętli. Upewnij się, że wciśniesz każdą linię wewnątrz pętli o kolejne cztery spacje i ponownie uruchom program. Program będzie teraz prosił o kolejny strzał w nieskończoność, co wprowadza nowy problem. Wygląda na to, że użytkownik nie może wyjść!

Użytkownik zawsze mógł przerwać program za pomocą skrótu klawiaturowego

ctrl-C. Ale jest inny sposób na ucieczkę przed tym

nienasyconym potworem, jak wspomniano w dyskusji o parse w sekcji

„Porównywanie strzału z tajną liczbą”: jeśli użytkownik wprowadzi

dane nieliczbowe, program ulegnie awarii. Możemy to wykorzystać, aby pozwolić

użytkownikowi wyjść, jak pokazano tutaj:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.23s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 59

Please input your guess.

45

You guessed: 45

Too small!

Please input your guess.

60

You guessed: 60

Too big!

Please input your guess.

59

You guessed: 59

You win!

Please input your guess.

quit

thread 'main' panicked at src/main.rs:28:47:

Please type a number!: ParseIntError { kind: InvalidDigit }

note: run with `RUST_BACKTRACE=1` environment variable to display a backtrace

Wpisanie quit spowoduje wyjście z gry, ale jak zauważysz, tak samo zadziała

wprowadzenie dowolnych innych danych nieliczbowych. Jest to, delikatnie mówiąc,

nieoptymalne; chcemy, aby gra zatrzymywała się również po odgadnięciu

prawidłowej liczby.

Zakończenie po prawidłowym strzale

Zaprogramujmy grę tak, aby kończyła się, gdy użytkownik wygra, dodając instrukcję

break:

Nazwa pliku: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

// --snip--

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => {

println!("You win!");

break;

}

}

}

}Dodanie linii break po You win! powoduje, że program wychodzi z pętli, gdy

użytkownik poprawnie odgadnie tajną liczbę. Wyjście z pętli oznacza również

wyjście z programu, ponieważ pętla jest ostatnią częścią main.

Obsługa nieprawidłowych danych wejściowych

Aby jeszcze bardziej dopracować zachowanie gry, zamiast zawieszać program,

gdy użytkownik wprowadzi dane nieliczbowe, niech gra ignoruje takie dane,

umożliwiając użytkownikowi dalsze zgadywanie. Możemy to zrobić, zmieniając

linię, w której guess jest konwertowane z String na u32, jak pokazano

w Listingu 2-5.

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

// --snip--

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");